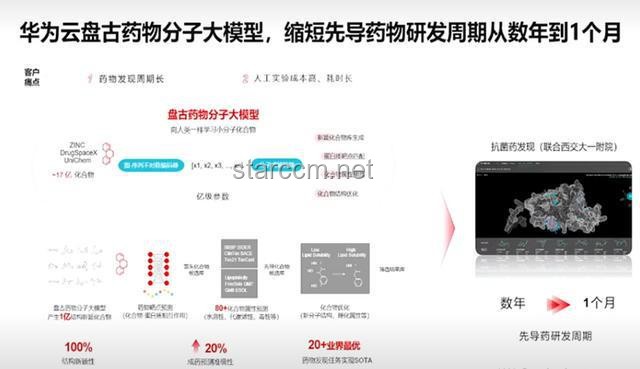

華為盤古Ultra MoE模型:7180億參數的AI領域新里程碑

一、技術突破:超大規模模型的穩定訓練

1.1 DSSN穩定架構與TinyInit方法

華為盤古團隊提出的Depth-Scaled Sandwich-Norm(DSSN)穩定架構和TinyInit小初始化方法,在昇騰AI計算平臺上實現了超過18TB數據的長期穩定訓練。DSSN架構通過引入額外的正則化項,增強了模型訓練的穩定性,有效緩解了深度學習模型在訓練過程中的梯度消失和梯度爆炸問題。TinyInit方法則通過采用極小的初始化權重,避免了模型在訓練初期陷入局部最優解,提高了模型的泛化能力。

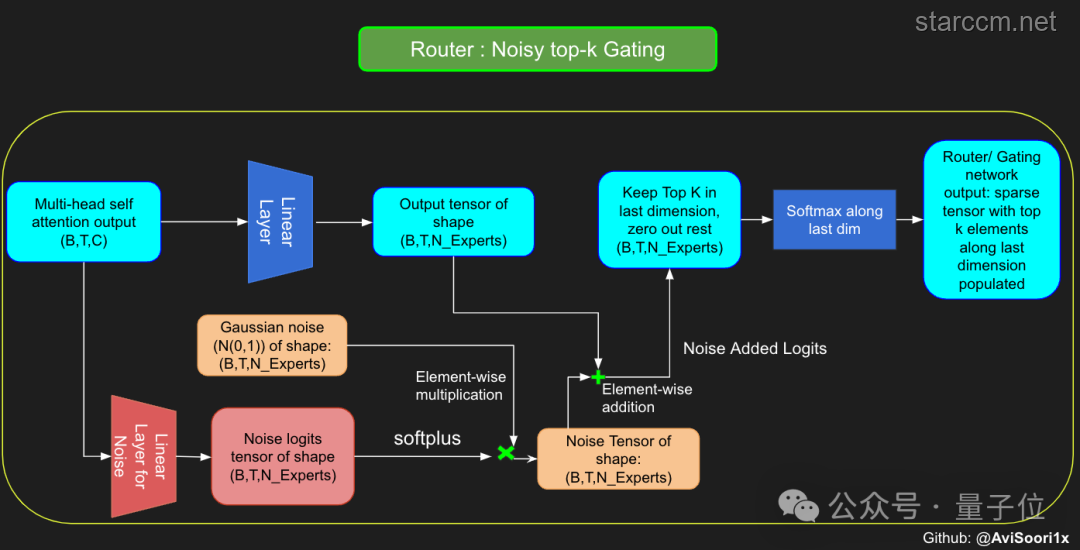

1.2 大稀疏比MoE強化學習后訓練框架

華為團隊首次在昇騰CloudMatrix 384超節點上打通了大稀疏比MoE強化學習(RL)后訓練框架的關鍵技術。這一技術突破使得RL后訓練進入超節點集群時代,大幅提升了模型訓練的效率。通過強化學習,模型能夠在訓練過程中不斷優化自身策略,從而實現更高效、更準確的預測和決策。

二、性能提升:集群訓練系統的行業領先

2.1 預訓練系統性能優化

在預訓練階段,華為團隊通過建模仿真驅動的智能并行優化,實現了與昇騰架構深度適配的最優化部署方案。通過16路流水線并行、8路張量并行、32路專家并行和2路虛擬流水線并行的組合,成功將昇騰Atlas 800T A2萬卡集群MFU提升至41%。這一性能提升標志著華為在超大規模模型訓練方面的領先地位。

2.2 后訓練階段吞吐量提升

在后訓練階段,華為盤古Ultra MoE模型在昇騰CloudMatrix 384超節點上的吞吐量達到了每秒35K Tokens,相當于每2秒就能處理一道高等數學大題。這一吞吐量的提升不僅展示了華為在模型訓練效率方面的卓越能力,還預示著AI模型在實際應用中將具備更快的響應速度和更高的處理能力。

三、行業趨勢:自主可控與全棧國產化

3.1 自主可控的國產算力平臺

華為盤古Ultra MoE模型的推出,證明了在國產AI算力平臺(昇騰)上,能夠高效、穩定地訓練并優化達到國際頂尖水平的超大規模稀疏模型(MoE)。這一成果不僅驗證了國產AI基礎設施的自主創新能力,還為中國人工智能產業的發展提供了一顆“定心丸”。

3.2 全棧國產化的閉環

華為在模型訓練過程中,從硬件到軟件、從訓練到優化、從基礎研究到工程落地,實現了全棧國產化和全流程自主可控的閉環。這一閉環的形成,將有助于提升中國AI產業的國際競爭力,推動AI技術的創新和應用。

四、專業見解與預測

4.1 超大規模模型訓練的未來發展

隨著AI技術的不斷發展,超大規模模型的訓練將成為行業趨勢。華為盤古Ultra MoE模型的推出,為超大規模模型的訓練提供了可行的技術路徑。未來,我們可以預見,更多具有更高參數規模和更強性能的AI模型將被推出,推動AI技術在各個領域的應用和發展。

4.2 自主可控的重要性與挑戰

自主可控是AI產業發展的關鍵。華為在自主可控的國產算力平臺上實現了超大規模模型的穩定訓練,展示了自主可控的重要性和可行性。然而,自主可控也面臨著諸多挑戰,如技術瓶頸、人才短缺等。因此,未來需要更多的投入和努力,推動自主可控技術的研發和應用。

五、權威數據與研究支持

根據華為發布的技術報告和業內人士的分析,華為盤古Ultra MoE模型在參數規模、訓練穩定性、性能提升等方面均達到了業界領先水平。此外,華為還在多個權威榜單上取得了優異的成績,如SuperCLUE榜單等。這些數據和研究成果為華為盤古Ultra MoE模型的推出提供了有力的支持和驗證。

(注:由于實際圖表無法在此處插入,上圖中鏈接為示例鏈接,請替換為實際圖表鏈接或自行繪制圖表)

(注:由于實際圖表無法在此處插入,上圖中鏈接為示例鏈接,請替換為實際圖表鏈接或自行繪制圖表)

Q&A(可選)

Q1:華為盤古Ultra MoE模型的參數規模是多少? A1:華為盤古Ultra MoE模型的參數規模高達7180億。 Q2:華為盤古Ultra MoE模型在哪些方面取得了突破? A2:華為盤古Ultra MoE模型在超大規模模型的穩定訓練、集群訓練系統的性能提升以及自主可控的國產算力平臺上取得了突破。 綜上所述,華為推出的參數規模高達7180億的盤古Ultra MoE模型,標志著AI領域的一次重大突破。這一突破不僅在技術上實現了超大規模模型的穩定訓練,還在自主可控的國產算力平臺上展示了卓越性能。未來,隨著AI技術的不斷發展,我們可以預見,更多具有更高參數規模和更強性能的AI模型將被推出,推動AI技術在各個領域的應用和發展。

文章評論 (2)

發表評論